黄仁勋“五层蛋糕”解读AI:火蓝如何为智能时代筑造坚实底座

- 日期 : 2026-03-13

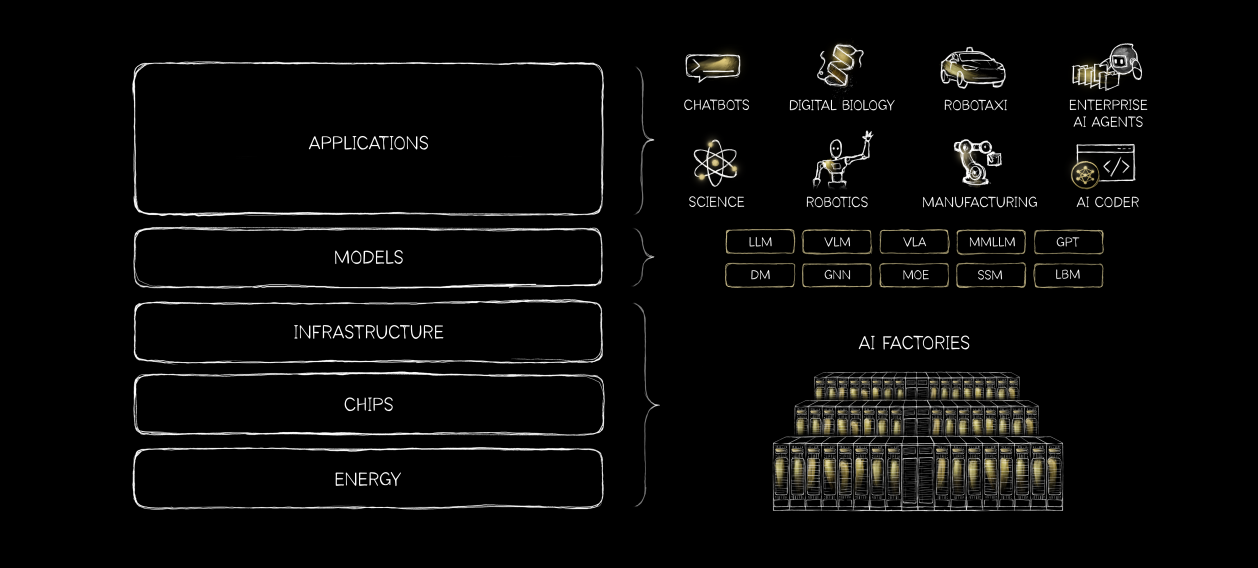

黄仁勋将AI架构分解为自下而上的五层:

能源:最底层,AI运行依赖真实电力,是智能生产的物理瓶颈

芯片:将能源转化为计算能力,决定AI发展速度

基础设施:即“AI工厂”,包括数据中心、网络等,是制造智能的载体

模型:在工厂上运行的AI大脑,能理解语言、科学等各类信息

应用:最顶层,经济价值在此实现,如自动驾驶、药物研发

这五层相互拉动:应用成功带动模型需求,模型进步需要更强基础设施,进而倒逼芯片升级和更多能源消耗。

一、AI究竟是什么?

AI,即人工智能,简单来说就是让机器模仿人类智能的技术——能看懂图像、理解语言、识别声音,并根据上下文进行推理和生成。但与以往不同,今天的AI已不再是简单的应用程序或单一模型,而是一种像电力和互联网一样必不可少的基础设施。

正如NVIDIA CEO黄仁勋所言:“AI依托真实的硬件、能源和经济体系运行,可以将原材料大规模地转化为智能。”这意味着,理解AI不能只看表面应用,而要深入其底层架构。

二、大模型与Token:AI的“大脑”和“语言单位”

大模型是当前AI浪潮的核心驱动力。它拥有海量的参数,经过大规模数据训练后,能够理解并生成文本、图像、代码等多种内容。我们熟知的ChatGPT、DeepSeek,背后都是大模型在支撑。Token则是大模型处理信息的基本单位。一段文字会被切分成一个个Token——可能是一个词、一个字符或一个子词。当你向AI提问时,它并非检索预先存储的答案,而是实时生成每一个Token,最终组合成完整的回复。黄仁勋特别强调:“每一个生成的Token,都是电子流动、热量管理以及能量转化为计算的结果。”

三、黄仁勋的“五层蛋糕”:拆解AI的完整图景

英伟达CEO黄仁勋用一个形象的“五层蛋糕”模型,帮我们看清AI的完整架构。这个模型从下往上依次展开,每一层都承载着不同的功能,又彼此紧密咬合。

最底层是能源。这听起来可能不够“高科技”,但却是最根本的基石。每一次你向AI提问、每一次模型生成回答,背后都是实实在在的电力在支撑。电能转化为计算,计算生成智能——没有能源,AI就是空中楼阁。这就像工厂需要电力才能运转,AI的“智能工厂”同样离不开源源不断的能量供给。

往上一层是芯片。芯片的任务,就是把能源高效地转化为计算能力。AI计算有个特点:需要同时处理海量任务,这就像让一个人同时听、说、读、写——普通芯片应付不来。所以AI芯片(比如GPU)专门为这种并行计算设计,它们拥有强大的并行处理能力、高带宽内存和快速互连技术。芯片的性能,直接决定了AI能跑多快、能长多大。

再往上是基础设施层。这一层就好比AI的“厂房”——数据中心。它包括土地、建筑、供电系统、冷却设备、网络通信,以及把成千上万芯片组织起来协同工作的整套系统。黄仁勋把这称为“AI工厂”,因为它们不是用来存放信息的仓库,而是真正“制造智能”的生产线。

基础设施之上是模型层。AI模型就像一个经过深度学习的“大脑”,能够理解各种复杂信息:人类的语言、生物学的密码、化学的分子式、物理世界的规律……我们常听说的语言模型只是其中一类。现在,专门研究蛋白质结构、模拟化学反应、训练机器人运动的专业模型,正在带来更具突破性的变革。

最顶层是应用层,也是经济价值最终兑现的地方。药物研发平台借助AI加速新药发现,工业机器人在车间里自主作业,法律助手帮律师梳理案卷,自动驾驶汽车在道路上行驶……这些都是AI应用的具体呈现。黄仁勋特别提到,自动驾驶是AI在机器上的应用,人形机器人则是AI在具身智能上的体现——同样的技术架构,却能衍生出截然不同的成果。

这五层之间不是孤立的,而是相互驱动、层层拉动的关系。一个成功的应用会拉动对更先进模型的需求,更强大的模型需要更坚实的基础设施支撑,基础设施的扩张倒逼芯片升级,芯片性能提升又带来更大的能源消耗。就像滚雪球一样,每一层的进步都会传导到其他层,形成整个产业的良性循环。

四、开源模型的爆发:DeepSeek与OpenClaw的启示

黄仁勋特别提到:“开源模型在这方面发挥着关键作用。当开放模型达到前沿水平时,它们改变的不是软件领域,而是激活了整个技术栈的需求。DeepSeek-R1就是一个很好的例子。”DeepSeek通过开放强大的推理能力,加速了应用层的普及,并带动了底层对训练、基础设施、芯片和能源的需求增长。这正是“五层蛋糕”相互拉动的最佳例证。

与此同时,开源AI智能体项目OpenClaw正掀起全民“养龙虾”热潮——它实现了AI从“对话”到“执行”的范式革命,让AI能直接操作电脑、处理文件、管理日程,成为真正意义上的“数字员工”。

五、火蓝产品如何融入AI五层架构

理解了AI的完整图景,我们就能看清火蓝在其中的位置——火蓝深耕基础设施层,并为模型层和应用层提供坚实支撑。火蓝旗下网络存储器、服务器及AI工作站已全面支持OpenClaw智能体部署。

在基础设施层,火蓝(Hoodblue)拥有完整的AI工厂构建能力,全面适配OpenClaw运行需求:

计算节点:火蓝GPU服务器支持8卡全互联,为千亿参数大模型训练提供澎湃算力。它们是AI工厂中高效运转的“生产机床”。

同时,火蓝服务器产品已全面适配OpenClaw部署,无论是个人开发者的实验环境,还是企业级的生产系统,都能获得稳定可靠的算力支撑。

火蓝AI工作站—专为AI开发者打造的桌面级算力平台。它集成高性能GPU与优化算力调度,让开发者可以在本地便捷地部署、测试和调试OpenClaw智能体,无需依赖云端资源。

无论是“养龙虾”的个人爱好者,还是需要快速原型验证的AI团队,火蓝AI工作站都能提供开箱即用的“数字员工”开发环境。

存储基座:火蓝全闪存存储读写速度高达14.7GB/s,传输一部4K电影仅需眨眼功夫,确保OpenClaw在多任务并发时配置文件、技能脚本、中间数据加载无延迟、响应更迅速。

火蓝分布式存储支持EB级线性扩展,单节点带宽4.8GB/s,可支撑数千个OpenClaw智能体的协同运行,成为AI工厂的“数据粮仓”。

网络互联:火蓝高速交换机提供100G超低延迟网络,专为AI集群优化,

确保GPU之间“聊天”不冷场,数据传输零丢包,打通AI工厂的“物流通道”。

安全保障:火蓝(Hoodblue)数据安全摆渡机采用军工级加密传输,

为高安全需求场景提供物理隔离级别的数据交换保障,构筑AI工厂的“安防系统”。

在模型与应用层,火蓝提供开箱即用的能力。

火蓝DeepSeek一体机将前沿开源大模型与硬件深度整合,实现开箱即用。

它预装模型训练、推理、部署全流程工具,让企业无需从零搭建技术栈,即可快速启动AI应用开发,加速从“模型”到“应用”的价值转化。

火蓝的AI NAS(“龙虾盒子”)系列为OpenClaw部署提供了针对性优化:

塔式8盘位TS3008-CNL:搭载高性能处理器,适合个人开发者与小型团队部署OpenClaw;

塔式12盘位TS3012-CNL:提供高密度存储,满足大规模数据采集与智能体训练需求;

机架式系列TS5008-CN/TS5012-CN:面向企业级OpenClaw应用,确保智能体服务永续在线。

六、火蓝的使命:为AI工厂筑造坚实基座

黄仁勋展望:“我们仍处于早期阶段。大部分基础设施尚未建成,大部分劳动力尚未接受培训,大部分机遇尚未得到发掘。”火蓝的使命,正是在这一历史进程中,以可靠的技术为AI工厂提供计算、存储和网络的全方位支撑,确保每一层都能高效运转,让“数字员工”的梦想照进现实。

无论您是构建大规模AI训练集群、部署OpenClaw智能体,还是进行边缘AI应用开发,火蓝都能提供从硬件到解决方案的全方位支持。